Microsoft активно интегрирует искусственный интеллект в свои продукты, такие как Windows и Office, что вызывает обеспокоенность пользователей в области конфиденциальности и доверия. Новые функции обещают повысить эффективность, но их внедрение натолкнулось на критику за возможное нарушение информационной безопасности.

Основные изменения в продуктах

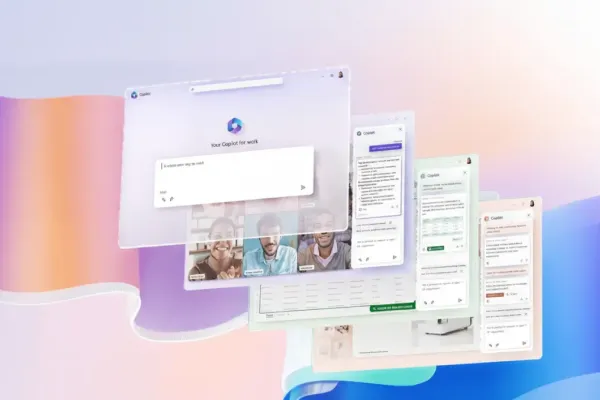

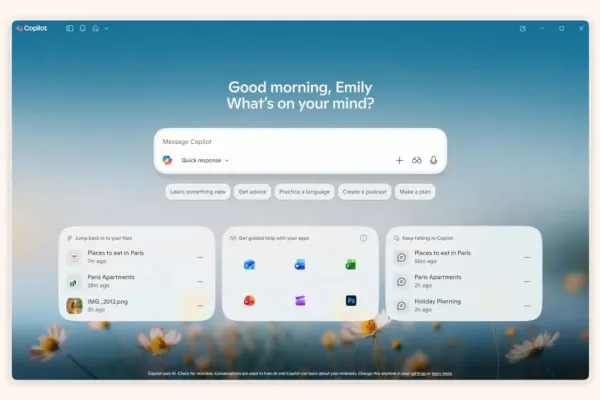

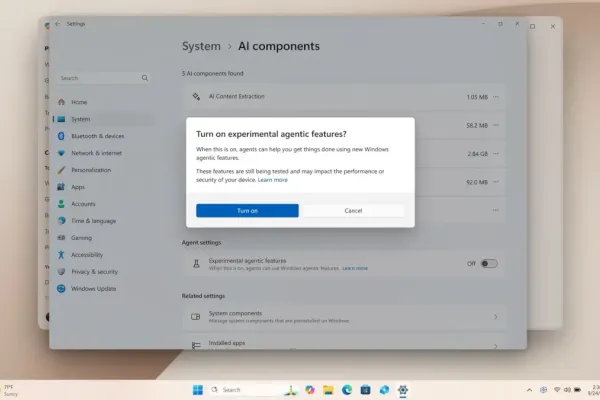

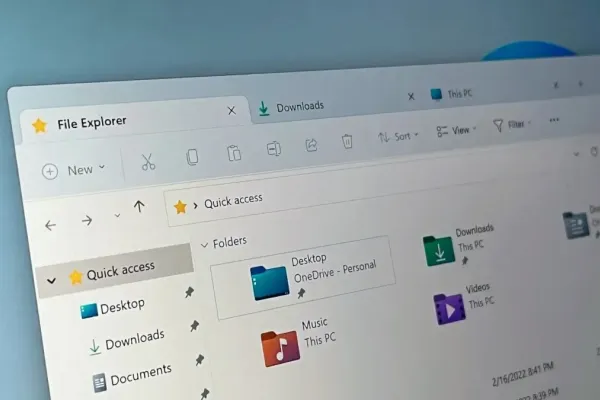

Ключевые изменения касаются продуктов Windows, Office и Teams, где появились такие функции, как Copilot в Windows 11. Эта функция предоставляет пользователям подсказки в реальном времени, однако нередко воспринимается как навязчивая и вмешивающаяся в рабочий процесс. Функция Recall, которая делает скриншоты для последующего поиска, тоже вызвала опасения по поводу безопасности данных и привела к задержке её полного выпуска.

- Copilot в Windows 11 предлагает подсказки в реальном времени.

- Функция Recall задержана из-за критики безопасности данных.

- Наблюдается использование AI в Bing и Edge с сомнительными методами сбора данных.

Как ИИ от Microsoft влияет на конфиденциальность пользователей

Риски и реакция пользователей

Конфиденциальность является центральным вопросом для критиков, которые утверждают, что некоторые AI-функции собирают значительные объемы личных данных. Это размывает границы между полезными инструментами и навязчивым отслеживанием. Вызывает дебаты также вопрос этики связанных с ИИ систем, особенно в контексте использования данных пользователей без чёткого согласия.

Представители отрасли имеют разное мнение. Разработчики и руководители признают потенциал AI, но предостерегают от чрезмерного ажиотажа. Инфраструктурные вызовы и возможность утекания кадров усиливают это беспокойство.

Экономические и технические вызовы

Экономические условия усложняют ситуацию. Компания вкладывает значительные средства в дата-центры и партнёрства, но сталкивается с проблемами принятия и монетизации AI-программного обеспечения. Медленные темпы усыновления и осторожность предприятий подрывают амбиции компании.

Задачи безопасности и надёжности также стоят остро: AI-функции создают новые уязвимости и требуют человеческого надзора. Опытные пользователи и компании пока что предпочитают дождаться более зрелых решений перед тем, как массово внедрить AI-проекты.

Представители Microsoft утверждают, что концентрируются на этичном развитии и целенаправленном внедрении, но критики предупреждают о рисках без надлежащих мер безопасности. Для пользователей технологическая навязчивость ИИ может быть стресс-тестом доверия, что требует от компании пересмотра своей стратегии.

Comments (0)